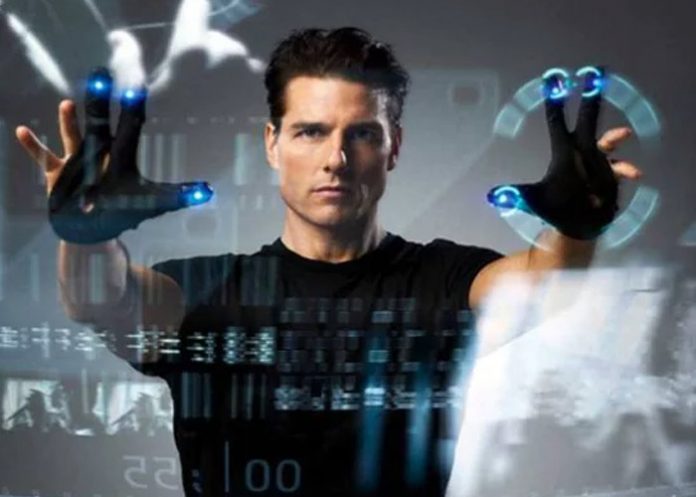

Anticiparse. Leer la mente. Identificar las intenciones y así prevenir los delitos. Esta idea que se grafica en el mundo futurista del film Minority Report ya es una realidad. O casi.

En China se comenzó a probar un sistema de vigilancia basado en inteligencia artificial que ayudaría a identificar a potenciales criminales.

"Si utilizamos bien estos sistemas e instalaciones inteligentes, podremos saber de antemano quién podría ser un terrorista, o cometer una ofensa", dijo Li Meng, viceministro de Ciencia y Tecnología chino en declaraciones al Financial Times.

La compañía Cloud Walk, que se encuentra en Guangzho, provincia de Cantón, utiliza imágenes obtenidas en cámaras ubicadas en sitios públicos y luego las analiza con inteligencia artificial.

El sistema emplea reconocimiento facial para identificar, por ejemplo, si se trata de un individuo con antecedentes penales. Incluso puede reconocer la expresión del rostro y podría inferir su emoción: ¿se ve nerviosa, relajada, enojada?

DeLorean quiere fabricar vehículos voladores

A eso se suma el análisis de los comportamientos y movimientos. Así, si el sistema identifica que, por ejemplo, una persona fue a un local de venta de armas y luego visitó, en reiteradas oportunidades, una misma esquina, como si estuviera haciendo un estudio de campo antes de cometer un delito (al menos según las previsiones de la inteligencia artificial) enviaría un alerta a la policía con estos datos.

En síntesis, el programa avisa al personal si evalúa que hay varios factores que resultan sospechosos.

¿Cuál es la tecnología detrás de este invento? Por empezar, hay inteligencia artificial para hacer los reconocimientos. Y a esto se suma el Big Data, que permite procesar los grandes volúmenes de información recogidos en el proceso.

"La policía usa un sistema de evaluación basado en Big Data para determinar si un grupo de personas es sospechoso en función de lo que hace y a dónde va", explicó un vocero de la compañía en diálogo con Financial Times.

En China no es la primera vez que se usa la inteligencia artificial para estos propósitos. Allí existe un sistema de reidentificación personal que permite identificar a un individuo aun cuando este se encuentre camuflado con máscara, peluca u otros elementos.

Si bien se supone que estos sistemas solo permiten tomar recaudos y no derivan en una condena efectiva (algo que resultaría insólito porque se trataría de castigar sin delito), de todos modos es un sistema que despierta polémica y que invita al debate.

El uso de la tecnología para anticiparse a la comisión de delitos pone en el tapete el tema de la privacidad y la seguridad de los usuarios: ¿hasta qué punto el Estado tiene derecho a observar a los ciudadanos?

Por otro lado, se puede argumentar que se está estigmatizando cuando se reúnen ciertos factores y en función de eso se estima que una persona podría cometer un delito. ¿Es así de predecible la conducta del individuo? ¿Acaso no hay posibilidad de tener intención y arrepentirse antes de cometer el ilícito? Un sistema que genera más preguntas que respuestas.